许多刚刚涉足 AI 模型训练、图形渲染或者高并发推理业务的团队,在看到 HostEase 前台 GPU 实例报价时的第一反应可能是“这块卡太贵了”。然而,作为一线的基础架构工程师,我见过的所有由于算力导致预算超标的“惨案”,真正的元凶从来不是 GPU 的绝对单价太高,而是:极其惊人的“显卡闲置率”。

你一定遇到过这样令人窒息的账单泄漏现场:算法工程师的训练任务在凌晨两点跑完了,但挂载着顶级显卡的云实例却依然满负载运行,白白空转到第二天早上他打卡上班;在线推理服务的潮汐波峰过去了,底层的算力矩阵却因为没人手动操作而继续维持满编队燃烧。

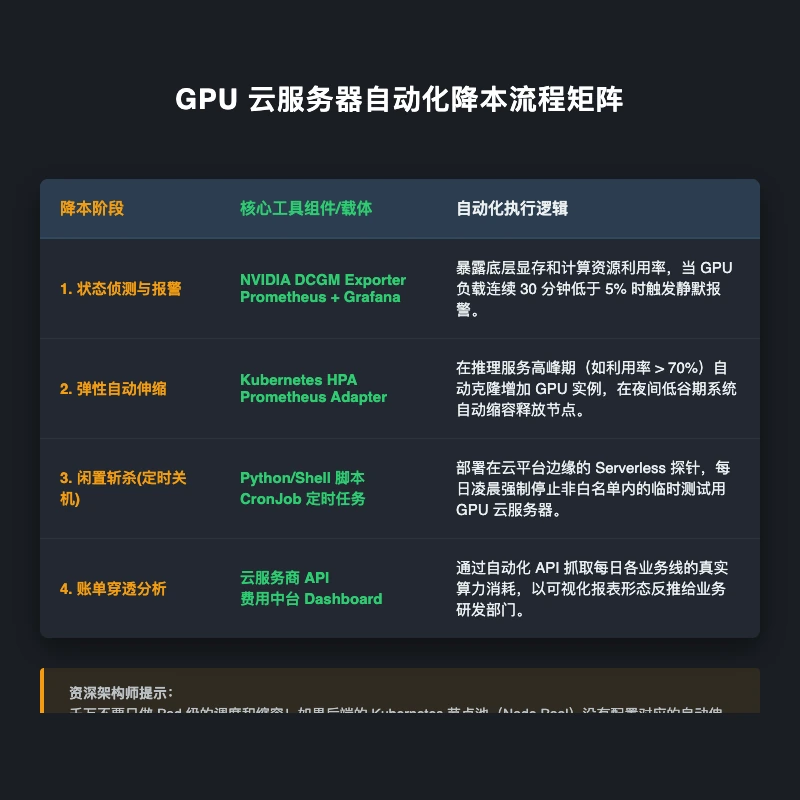

如果靠管理规定和人力记忆去关停实例,出问题只是时间早晚。唯一的破局点是:用自动化闭环取代人力操作。

一、告别无脑扩容:让显卡自己“说话”

绝大多数早期的草台班子在遇到服务响应慢时,最原始的逻辑就是:“显卡不够了,去控制台再开两台 GPU [云主机](https://cn.hostease.com/vps/)”。但你真正确定是算力满载了吗?

我们要做的第一步降本,就是将 底层硬件利用率暴露给上层控制器。在生产云原生环境中,技术团队必须抛弃单纯的 CPU/内存监控,转而部署如 NVIDIA 的 DCGM Exporter。

通过这套挂件,你可以将极其细颗粒度的“算力使用率(SM Utilization)”和“显存占用量(Memory Usage)”实时暴漏给 Prometheus 监控大屏。一旦让数据透明化,你就会震惊地发现,很多原本你以为“火力全开”的 GPU 云架构 节点,其实际日均负载甚至不足 15%。

二、构建弹性斩杀闭环:K8s HPA 与定时关机脚本的联动

发现闲置只是开始,我们需要系统拥有一双“自动斩杀”的无情铁手。

- 在线推理场景的 HPA 自动缩伸:借助于 Prometheus Adapter,我们可以把自定义的 GPU 负载作为 Kubernetes HPA (水平 Pod 自动伸缩) 的硬性阈值。设定一个目标(比如利用率 60%):当白天峰值流量涌入,系统自动横向扩展 Pods 并弹出新的 GPU 云服务器节点;一旦子夜时分流量退潮,系统将逐步缩减 Pods,并在底层配合 Cluster Autoscaler,彻底关停并释放空闲的 GPU 云主机资源。

- 研发训练场景的“下班探测”:针对开发人员的试验田,最简单粗暴的降本武器就是一小段依托于定时任务 (CronJob) 触发的 Python API 脚本。让脚本每天深夜去扫描带有

env: dev_training标签的所有 GPU 实例。只要探测到过去一小时内显卡负载低于 5%,就毫不留情地向云平台 API 发送StopInstance关机指令,阻止算力的空转。

三、将算力成本沉淀至业务方,根治无序浪费

想要在根本上降低企业级的 GPU 成本,技术部的努力还不够,需要将压力分摊给业务方。利用云服务商提供的成本探查 API,你可以编写一个每日定时生成账单的自动化报表系统:

将 A 业务线(如 OCR 识别)和 B 业务线(如 AIGC 画图)昨天的纯 GPU 算力成本精确到小数点,通过飞书/钉钉的机器人推送出去。一旦费用具象化,业务方会自动开始优化他们的模型切片和推理算法。

无论你是跑个小模型,还是部署数万并发的行业智算网络。一台高度灵活、随时能通过 API 和脚本执行微秒级控制的 海外独立 GPU 服务器 结合上这套自动化“挤水分”的机制,才能在这场百模大战和算力荒中存活下来。