每到毕业季或实验室横向课题攻坚期,计算资源的匮乏往往是阻碍同学们推进论文复现的最大绊脚石。当你满怀激情地拉取了 GitHub 上的千亿大模型源码,却发现自己宿舍的轻薄本连依赖包都装不下;更令人扎心的是,去云平台上随便瞄了一眼顶级 GPU 云服务器 的包月价格,那一串账单往往比你一个月的生活费还要夸张。

但其实,对于极度缺乏预算却又渴望澎湃算力的开发者、学生与研究者而言,云计算厂商早在底层就为你们留下了各种合法薅羊毛的“后门”。在 HostEase 等全球化平台上,真正的极客绝不会老老实实地去购买原价的包月套餐。今天这篇指南,将教你如何用几杯咖啡的钱,撬动实验室里都申请不到的顶配显卡。

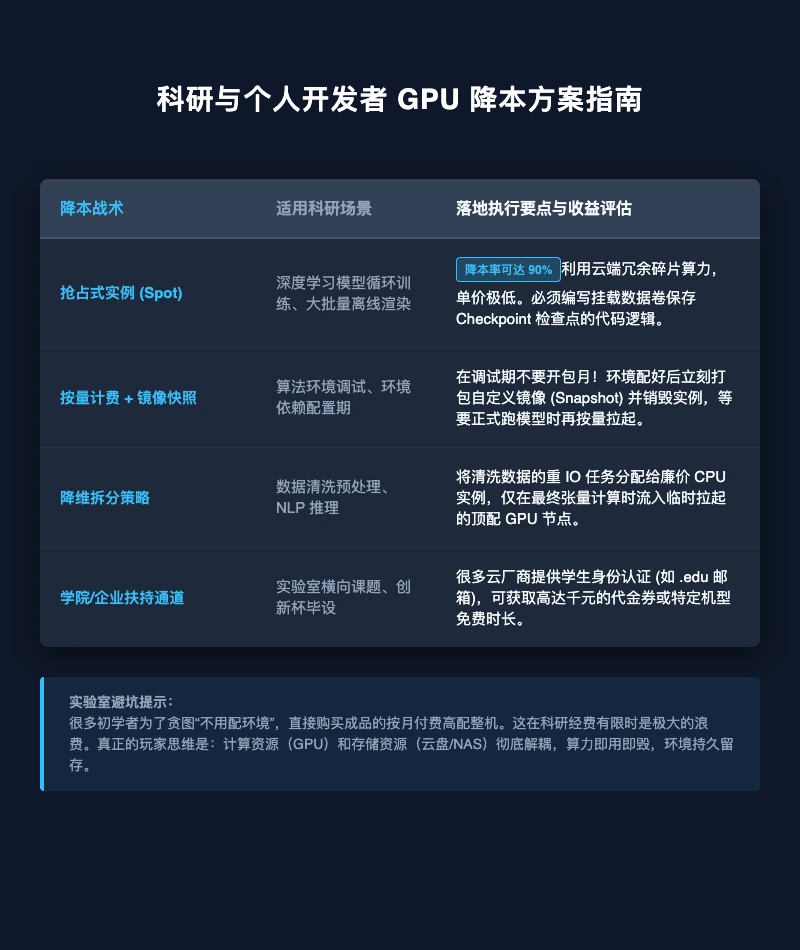

一、最强降维打击:用好“抢占式实例 (Spot Instances)”

所有云厂商的机房里,都会常备大量的冗余硬件资源以应对突发的商用洪峰。当这些硬件闲置时,为了收回一点电费,厂商会把这部分 GPU 算力以极其夸张的跳楼价抛售出去——这就是“抢占式实例”。

折扣力度有多疯狂? 通常只有原价的 10% 到 20%!

但天下没有免费的午餐,抢占式实例的代价是:云厂商有权在商用客流涌入时,强行中断并回收你正在跑模型的这台机器(通常只提前 3 分钟通知)。不过对于科研党而言,这完全不是问题:

- 代码层植入 Checkpoint:在你的 PyTorch 或 TensorFlow 训练脚本中,加入每完成一个 Epoch 就向外挂云盘持久化保存参数快照的逻辑。一旦机器被回收,下一次重新竞价拉起机器时,直接读取断点继续训练即可。

- 存储与算力解耦:模型代码和数据集千万不要放在算力主机的本地盘,而是应当寄存于挂载的纯 SSD 数据卷中,做到“算力即插即拔,数据永不丢失”。

二、按量计费的“快进快出”心法

很多新手烧钱的坏习惯在于:环境配置花了 3 天,跑模型只花了 2 小时,但却为这 3 天的显卡空转买单。

正确的打法是:在配置复杂的 CUDA 环境或清洗脏数据阶段,开一台最便宜的入门级 CPU 虚拟机。等所有的依赖安装完毕,代码完全调通后,立刻给这台系统盘打一个 镜像快照(Image Snapshot)。然后销毁这台 CPU 机器。

接着,利用刚刚打包好的绝版镜像,去按量付费(Pay-as-you-go)临时拉起一台带有顶级 GPU 显卡的巨兽实例。把跑模型的几个小时跑完,拿到数据后立马销毁!这种极限的“快进快出”,能把无效算力消耗降至趋近于零。

三、企业级独服的终极平替:实验室组团“批发”

如果你的实验室正面临一个海量张量计算的长期大项目,且科研经费能够覆盖一定级别的预算,那么整天盯着按量计费其实是一种时间成本的极大浪费。抢占式实例被频繁回收也会阻断大型协作的流畅度。

此时,最高性价比的方案是:联合课题组的师兄弟们,直接找代理商全资包下一台 海外独立 GPU 服务器(Bare Metal)。一台具备完整物理隔离权限的高端显卡母机,能够由导师自行在底层虚拟化拆分出十几个环境给不同学生做课题。

别让硬件的贫瘠限制了你的才华。熟练掌握上述云端生存法则,你就能在有限的科研舞台上,压榨出极其可观的工业级算力火花。