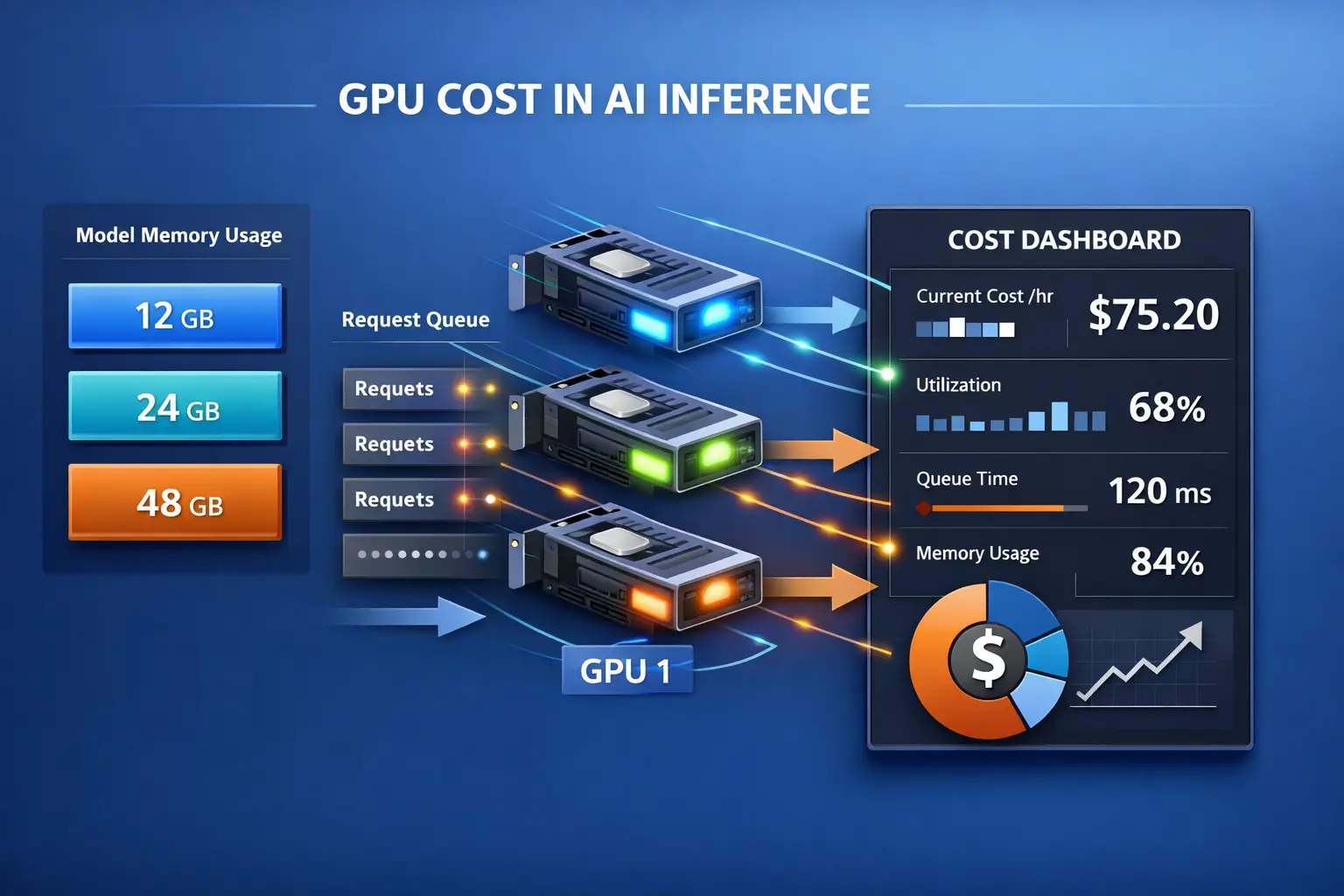

很多团队第一次认真做 AI 推理上云时,会把注意力都放在 GPU 型号上:这张卡快不快、核心多不多、是不是新一代。可实际账单跑几周以后,真正拉开成本差距的,往往不是纯算力,而是显存和调度。模型装不下、批处理配不好、实例空转时间长,这些问题比“芯片差一点”更容易把钱烧掉。

GPU 成本之所以在推理阶段更看显存与调度,是因为线上服务和训练完全不同。训练可以围绕大任务集中冲刺,推理则要围绕不同长度的请求、不同规模的并发和不同类型的模型持续运行。只要显存分配和实例调度没做对,再好的 GPU 也会在低效率里被浪费掉。

这也是为什么很多团队上线后才发现,自己不是买错了算力,而是没有把资源利用率想明白。相关的服务器与资源配置思路,可以顺带看 HostEase 的 服务器文章。因为在推理阶段,成本优化更像运营问题,而不只是采购问题。

为什么显存常常比算力更先成为瓶颈

因为很多模型能不能上线,不是由算得快不快先决定,而是由装不装得下先决定。参数规模、上下文长度、缓存策略、并发会话和额外服务组件,都会一起占用显存。只要显存吃紧,团队就会被迫降模型、降上下文,或者直接上更贵的实例。

更麻烦的是,显存问题往往不只影响“能不能跑”,还影响“能不能稳定跑”。模型刚启动能通,并不代表高峰时还稳。很多看起来是性能问题的故障,本质上其实是显存余量太小,导致服务抖动和实例反复重启。

为什么调度策略会直接决定成本高低

推理服务很少是单一请求模式。有的请求短,有的请求长;有的峰值明显,有的全天分散;有的模型需要长期热启动,有的可以接受冷启动。调度一旦粗糙,就会出现一种常见情况:GPU 并没有被真正打满,但实例却一直开着,月账单照样很高。

所以成本控制的关键,不只是把卡买对,还要把请求放对。哪些服务需要独占,哪些模型可以共用,哪些实例适合弹性扩缩,哪些负载更适合按时段切换,这些都属于调度问题。团队一旦忽视这层,GPU 预算几乎必然越来越难看。

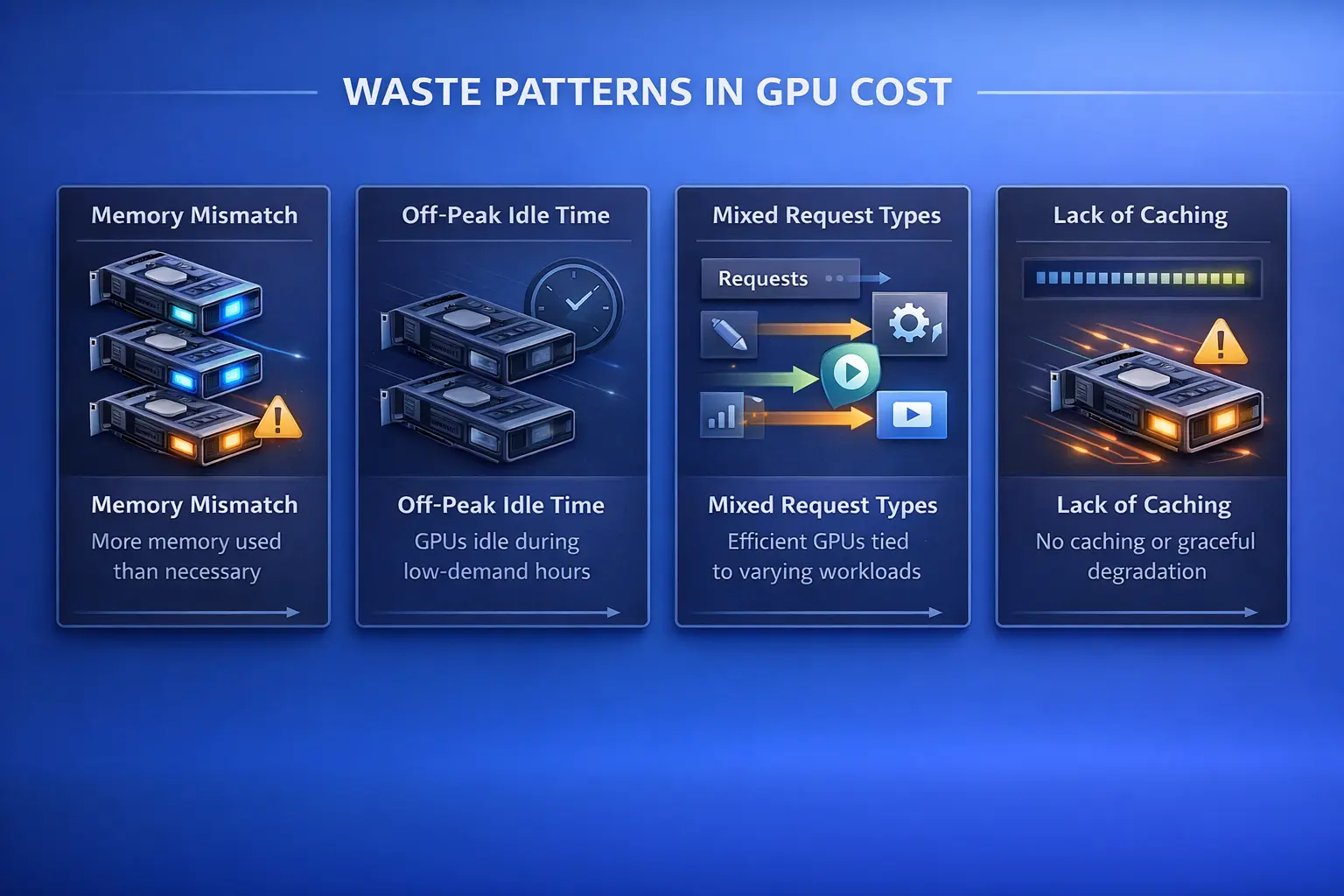

推理业务里最常见的 4 种资源浪费

1. 模型和实例显存不匹配

模型稍微大一点就必须上更高规格实例,但高规格实例又经常被低负载长期占着,最后形成“为了装下模型而整机浪费”的情况。

2. 高峰和低峰用同一套配置

白天高峰需要更强并发,不代表夜间也要维持同样规模。没有分时调度,很多钱会烧在低峰空转上。

3. 不同请求类型混在同一条服务上

短请求和长请求如果全混在一起,调度和排队就更难做好,最终不是延迟拉高,就是资源利用率变差。

4. 缺少缓存和降级策略

能缓存的结果不缓存,能降级到更轻模型的场景不降级,都会让高成本 GPU 长期处理本可更便宜完成的任务。

为什么很多团队误以为自己缺的是更强 GPU

因为更强的 GPU 最直观,也最容易采购。但直观不等于问题真的在这里。很多团队的真实症结,是资源利用方式粗糙:显存挤不下、模型排不合理、实例切换不灵活、负载分层做得太晚。此时一味追更大卡,只是把低效率搬到了更贵的平台上。

这也是为什么推理成本优化往往先从观测开始,而不是先从采购开始。先看平均显存占用、高峰并发、请求时长分布和闲置时段,团队才知道问题是在模型、在服务形态,还是在调度。

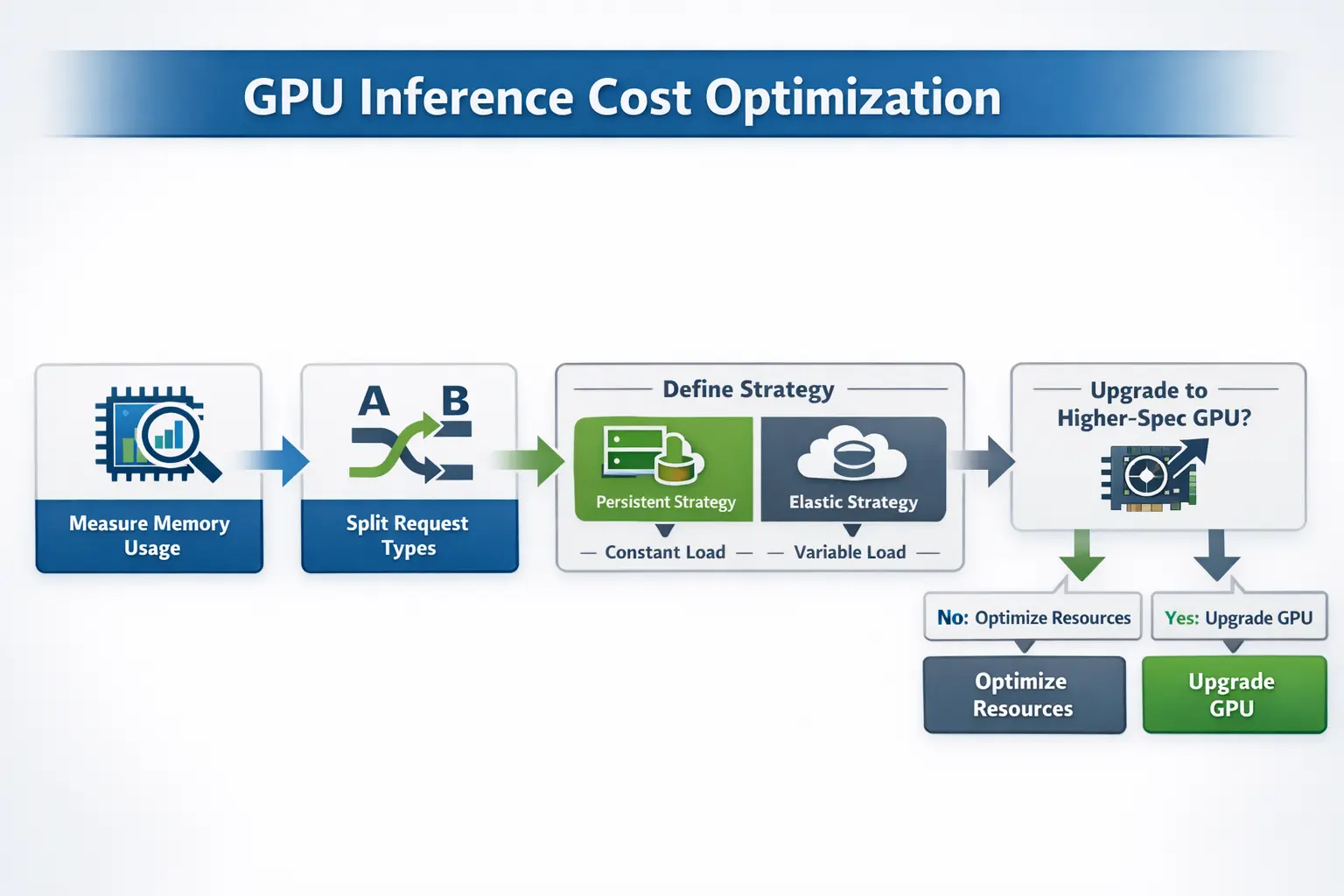

更务实的优化顺序是什么

第一步,先量清楚显存。 模型本体、上下文缓存、并发会话到底吃掉多少显存,必须先算明白。只要这一步含糊,后面所有实例选择都会带着猜。

第二步,把请求分层。 高频短请求、长上下文请求、低价值后台任务不要全部混跑。不同负载拆开后,调度才有空间优化。

第三步,决定哪些场景必须常驻,哪些可以弹性。 真正需要低延迟的入口,值得保留热实例;可容忍等待的任务,可以用更节省的方式承接。

第四步,再考虑是否升级更高规格 GPU。 到这一步再花钱,预算才更容易花在刀刃上。

这对中小团队尤其重要

因为中小团队通常没有大厂那样的容错预算。一次调度做错,不只是浪费几台机器,而是会直接影响产品毛利和上线节奏。越是预算有限,越不能把 GPU 成本只理解成“买哪张卡”。

真正能把推理业务长期跑稳的团队,往往不是最早买到最强实例的团队,而是最早把显存和调度看成一体问题的团队。只要这层逻辑建立起来,后面的采购、扩容和降本都会更有依据。

还有一个常被低估的因素是团队协作成本。只要资源切换全靠人工记忆,某个模型该上哪台、哪个时段该缩容、哪个服务允许降级,都会变成经验活。经验活越多,GPU 成本越难持续优化,因为每次调整都依赖少数人临时判断。

所以推理成本治理最终一定会走向“可解释”。团队不仅要知道钱花在哪,还要知道为什么会花成这样。只有把显存、负载、调度和服务等级挂上钩,GPU 预算才不会在业务扩张时重新失控。

结语:推理上云以后,GPU 成本管理更像系统工程

AI 推理业务上云后,GPU 成本为什么更看显存与调度?因为线上服务真正烧钱的,不是那一瞬间的最高算力,而是整个月里资源有没有被合理利用。显存决定你能承接什么,调度决定你会不会一直多花钱。

所以比起只盯 GPU 型号,更值得优先做的,是把模型装载、并发结构、缓存策略和实例调度梳理清楚。只要这些环节逐步清楚,GPU 账单通常就会比单纯换卡更快变好看。