过去提到 GPU 云服务器,大家首先想到的通常是模型训练。训练任务重、显卡贵、周期长,所以很自然地占据了很多讨论中心。但到了 2026 年,越来越多团队真正花钱最多、上线最频繁的环节,已经不再是训练,而是推理。模型一旦开始服务真实用户,GPU 的消耗方式就和实验室阶段完全不同。

GPU 推理负载之所以越来越重要,是因为 AI 应用正在从“做出模型”转向“把模型稳定地跑起来”。很多团队并不每周训练新模型,却每天都要承接问答、生成、检索增强、图像处理或业务自动化请求。只要产品真正进入使用阶段,GPU 的长期成本和稳定性压力就会集中落在推理这一侧。

这件事对主机和资源规划的影响很直接。相关的配置思路,可以顺带看 HostEase 的 服务器文章 和 [VPS](https://cn.hostease.com/vps/) 内容。因为一旦工作重心从训练转向推理,你关心的就不只是算力峰值,而是持续运行、显存适配和调度效率。

为什么训练看起来更重,推理却更容易变成长期主负载

训练确实更吃算力,也更容易制造“大任务”的存在感。但训练往往是阶段性的,很多团队会集中做几轮实验,然后进入较长时间的验证和应用阶段。推理则不同,它会伴随产品上线、客户接入、接口调用和日常业务运行而持续发生。只要用户在用,推理就在烧资源。

从成本结构看,训练更像一次大额项目,推理更像持续账单。前者让人紧张,后者更容易被低估。也正因为如此,很多团队最开始把 GPU 预算都想在训练上,后来才发现真正拖长周期、拖高月度开销的,是推理服务本身。

推理负载对 GPU 资源的要求,和训练并不一样

训练更强调吞吐、长时间跑满和实验效率;推理更强调延迟、并发、显存适配、服务稳定性和上下文管理。换句话说,训练关心“多久能学完”,推理关心“能不能一直稳地答”。这会直接改变团队选择云服务器时的关注点。

很多时候,推理不一定需要最极致的算力卡,但会更在意显存够不够、部署是否方便、实例是否稳定、网络是否平稳。因为用户面对的是产品体验,而不是训练曲线。只要响应抖动大、上下文撑不住或并发不稳,业务方就会立刻感受到问题。

GPU 云服务器为什么会更偏向承接推理,而不是大规模训练

1. 训练越来越集中到少数高规格环境

真正大规模训练往往更适合专门集群、预留容量或高度定制化环境。普通 GPU 云服务器当然也能训练,但对很多中小团队来说,它们更常被拿来做验证和微调,而不是长期承接大规模训练生产力。

2. 推理更贴近产品上线节奏

只要模型要对外服务,GPU 就得跟着业务节奏长期在线。相比训练阶段的集中爆发,推理更像一条持续运行的基础设施链路。

3. 中小团队的 AI 产品更依赖部署速度

很多团队没有条件长期养一套复杂训练平台,但他们确实需要尽快把已有模型、开源模型或蒸馏模型接进业务。此时 GPU 云服务器的价值,就更偏向“把服务稳定跑起来”。

这会改变团队怎么选主机

如果你的重点是推理,那么 GPU 方案的判断标准就不该只看 TFLOPS 或“能不能训”。你更应该看实例是否容易部署、显存是否匹配模型、网络是否稳定、磁盘与镜像是否方便、能否和现有服务架构衔接。很多看上去配置更猛的方案,未必是更好的推理环境。

这也是为什么同样是“买 GPU”,训练思路和推理思路会完全不同。训练偏向一次性冲刺,推理偏向长期运维。前者更像研究任务,后者更像线上服务。

最常见的误判:以为训练需求大,推理自然就不贵

很多团队早期只看训练账单,会觉得只要训练完成,后面压力就小了。现实却往往相反。模型一旦进入真实业务,推理的调用频率、峰值时段和持续运行时间,会把月度资源账单慢慢拉高。尤其是需要长上下文、较高并发或图像类处理的业务,这种感觉更明显。

所以真正成熟的预算判断,不是只问“训练贵不贵”,而是要问“上线后每天跑多久、并发多高、缓存和降级怎么做、显存能撑多久”。很多团队真正需要补的,不是训练资源,而是推理资源视角。

一份更务实的判断方法

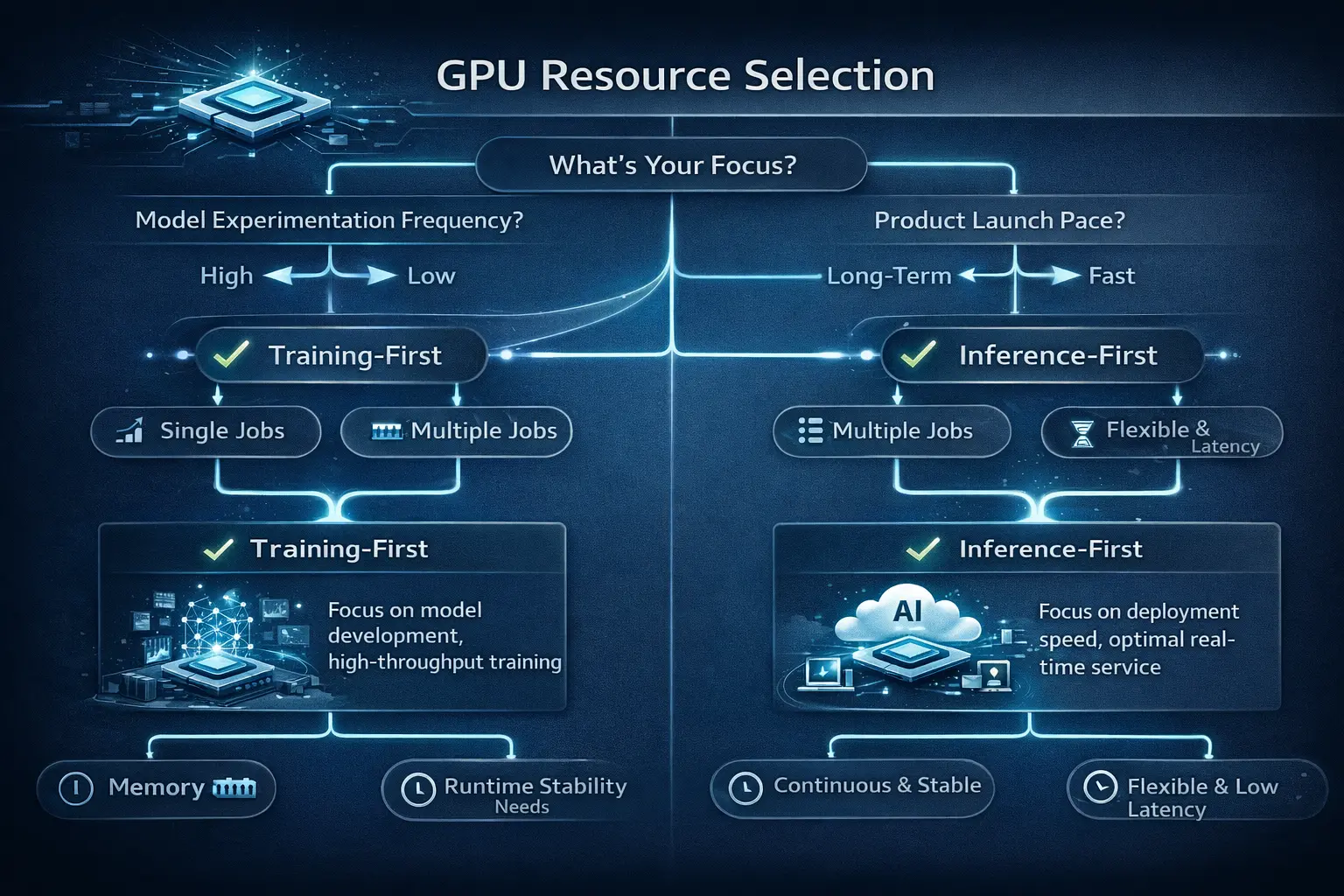

先看未来 3 个月里,团队主要是在做模型实验,还是在做产品交付。如果主要是交付,就默认把 GPU 预算更多地往推理端看。再看模型大小、上下文长度、平均并发和峰值请求,把这些因素拉出来,你会很快知道自己更需要“训练能力”,还是“稳定推理能力”。

只要这个判断先做清楚,很多主机选择就不会再跑偏。因为你买的不是一块显卡,而是一种工作负载的承接方式。

很多团队还会忽略一个现实变化:越来越多应用其实是在复用现成模型,而不是从零训练自己的大模型。只要路线从“造模型”切到“用模型”,GPU 的价值就会更偏向服务交付。这个变化看似细小,却会直接改变采购、部署和监控的重点。

换句话说,GPU 云服务器需求从训练转向推理,并不是训练突然不重要了,而是业务化阶段把资源重心往线上服务推了过去。团队越早接受这一点,越容易把预算花在真正长期消耗资源的地方,而不是继续沿用实验室阶段的判断方式。

结语:GPU 云服务器的重心变化,本质上是 AI 从实验走向业务

GPU 云服务器为什么越来越偏向推理负载,而不是训练?因为越来越多团队真正需要解决的,不再是“把模型做出来”,而是“让模型稳定、持续、可控地服务业务”。训练当然还重要,但它已经不再是唯一中心。

从这个角度看,GPU 资源重心的变化,其实就是 AI 应用开始走向现实业务的标志。只要团队的目标从实验转向上线,推理就一定会成为更长期、更值得精细规划的部分。